在高端虚拟制片影棚里,TD(技术总监)们流传着一句极其冷酷的行话:“静态像电影,一动像动画。”

只要摄像机保持静止,UE5渲染出的画面总是完美无瑕的。但只要导演喊“推轨(Dolly In)”或者跟焦员开始“转动焦点(Pull Focus)”,灾难就开始了: 虚拟背景的边缘会产生诡异的形变,AR合成的物体会脱离物理桌面,虚拟地板会在实拍演员的脚下产生几厘米的“滑动”。

导致这种灾难的根本原因,是真实与虚拟世界在“光学法则”上的根本性割裂:

- 针孔相机悖论: 虚幻引擎(UE5)内部的虚拟摄像机,是一个完美的“针孔摄像机(Pinhole Camera)”,它的视锥体边缘是绝对笔直的。而现实中的电影镜头(哪怕是顶级的ARRI Master Prime),都不可避免地存在桶形/枕形畸变(Barrel/Pincushion Distortion)和边缘色散(Chromatic Aberration)。

- 呼吸效应的维度坍缩: 当跟焦员改变实体镜头的焦距时,不仅画面焦点会变,镜头的物理视场角(FOV)也会发生微小的缩放(这就是呼吸效应)。如果引擎不知道FOV发生了变化,透视就会立刻错位。

- FIZ数据与追踪数据的时间差: 镜头的FIZ(焦点Focus、光圈Iris、变焦Zoom)编码器数据,通常和6DOF空间追踪数据走的不是同一条协议,到达引擎时往往存在微秒级的错位。

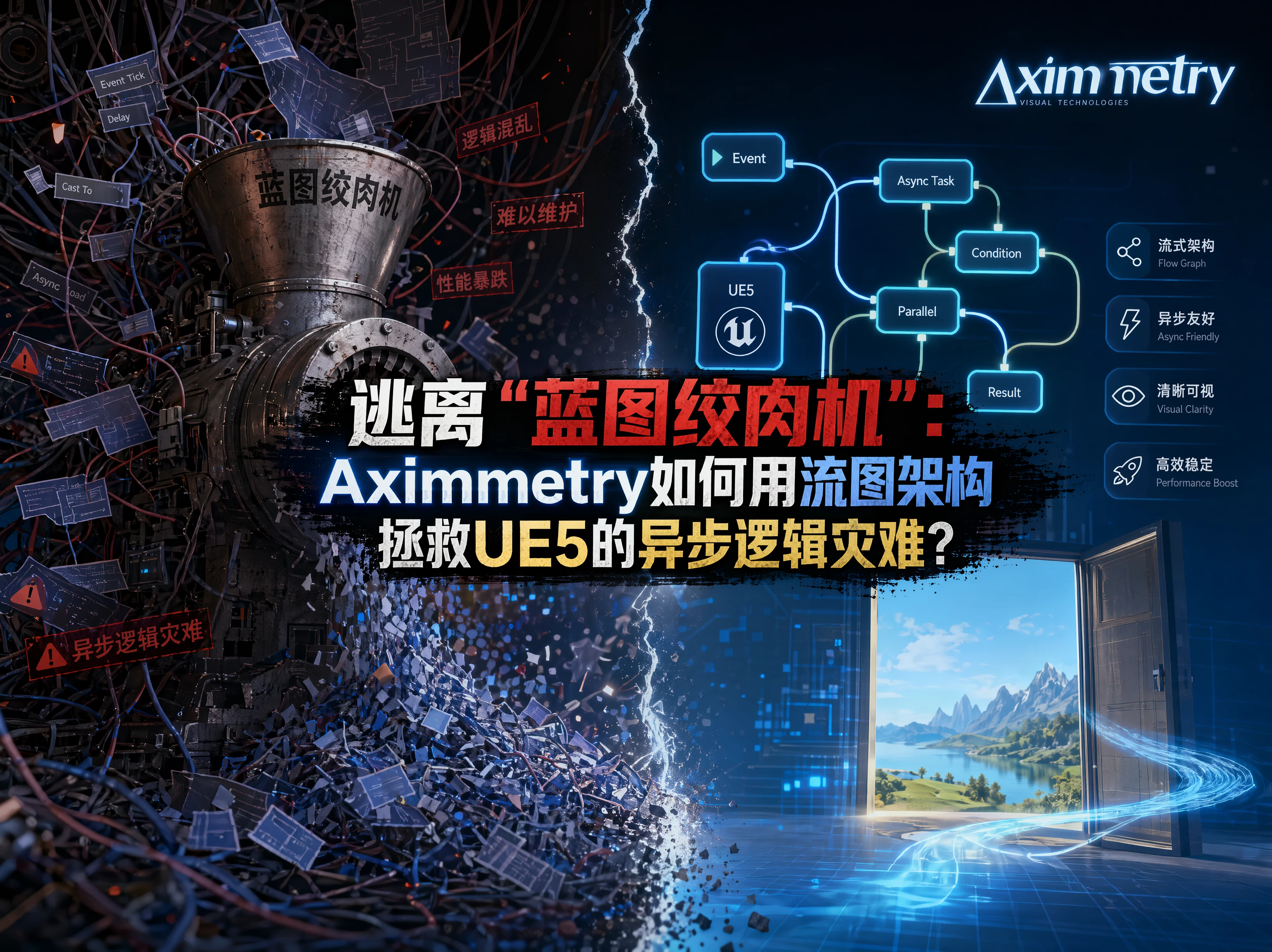

如果依赖原生UE5管线去处理这些问题,你需要与繁琐的Lens Component搏斗,在蓝图里手动去对应各种多项式畸变参数,一旦更换物理镜头,整个剧组可能要停工一小时来重新做棋盘格标定(Checkerboard Calibration)。

面对这个让行业痛不欲生的“滑移”死结,Aximmetry拿出的杀手锏是:将光学标定彻底从引擎侧剥离,建立独立的光学档案与全自动畸变合成管线。

核心解法一:剥离引擎的独立“光学档案(Lens Profile)”提取

Aximmetry深刻地认识到,让游戏引擎去实时计算复杂的物理镜头畸变多项式,不仅效率低下,而且极易出错。

因此,Aximmetry开发了完全独立的Aximmetry Camera Calibrator(摄像机标定工具)。

- 在正式开拍前,TD不再需要打开UE5。而是直接在Aximmetry的标定软件中,通过高精度的算法对摄像机进行扫板。

- 这个工具不仅能精准测算出摄影机的光学节点(Nodal Point)(即光线在镜头内部交叉的那一个绝对中心点,追踪系统必须以这个点为坐标原点,否则必滑移),更能记录下镜头在不同焦段、不同对焦距离下的所有畸变网格与FOV变化。

- Aximmetry将这些极其庞大的非线性光学特征,压铸成一个极度精简的专有

.xml或.axi光学档案(Lens Profile)。 - 在直播或拍摄时,UE5根本不需要知道这些复杂的畸变参数,它只需要绝对服从Aximmetry通过这些档案实时推算出的最终FOV指令即可。

核心解法二:重构“去畸变/重畸变(Undistort/Redistort)”合成管线

在AR直播或绿幕合成中,到底是让引擎去适配畸变的实拍画面,还是让实拍画面去适配完美的引擎画面?

原生的管线往往在这里陷入算力与画质的纠结。 Aximmetry在底层的图像管线中,强制确立了“光学真理的二次映射(Two-Pass Distortion Pipeline)”规则:

- 输入端的极速“去畸变(Undistort)”: 当实拍视频流(带有镜头桶形畸变)进入Aximmetry时,它在进入核心抠像与合成模块之前,Aximmetry利用预先生成的Lens Profile,在GPU底层以不到1毫秒的速度,将实拍画面强行“拉直”为与UE5一模一样的完美线性透视。 在这个“绝对平直”的三维空间里,UE5渲染的AR元素与实拍人物进行Z-Depth(深度)计算和Alpha融合,确保所有的边缘、遮挡关系在数学上完美咬合,没有任何因为畸变带来的边缘错位。

- 输出端的精确“重畸变(Redistort)”: 画面合成完毕后,绝对完美的合成图像对于人眼来说反而是“假”的,因为它缺乏了真实镜头的光学瑕疵。Aximmetry在最终输出节点(Video Out)前,再次调取Lens Profile,给整个合成画面重新压上与真实镜头一模一样的桶形畸变、边缘衰减(Vignette)甚至轻微的色差。

将这套复杂的变形运算彻底独立于UE5之外,不仅保全了引擎的渲染性能,更赋予了画面无可挑剔的物理胶片质感。

核心解法三:FIZ、追踪与视频的“三相锁频矩阵”

光学标定再准,如果数据到达的时间不一致,依然会滑移。 在推拉镜头(Zoom)时,变焦马达的编码器数据(FIZ)必须与画面的物理缩放,在同一个纳秒内生效。

Aximmetry在其底层I/O调度器中,建立了一个“三相锁频矩阵(Tri-Sync Matrix)”。 作为TD,你可以在流图(Flow Graph)中清晰地看到三条独立的数据流:

- Video In(视频流)

- Tracking Data(6DOF空间追踪数据)

- Zoom/Focus Encoder Data(镜头马达数据)

Aximmetry原生支持Free-D、Mo-Sys、Stype等协议中夹带的FIZ子通道,或者独立的编码器硬件。它在引擎计算前,强制这三种数据流进入一个基于Timecode(时间码)的对齐缓冲区。 它会根据预设的延迟参数,确保“镜头焦段缩放的瞬间”、“空间位置移动的瞬间”与“物理画面变化的瞬间”被严丝合缝地铆接在同一个数据帧(Frame)上,然后再将这个完美的复合指令下发给UE5。 这彻底消灭了推拉摇移时,虚拟背景因为数据不同步而产生的令人眩晕的“果冻效应”和“滑动延迟”。

结语:捍卫三维空间的“光学真理”

在虚拟制片的修罗场里,最昂贵的从来不是显卡的算力,而是“绝对的精准度”。

如果不能解决镜头畸变与透视滑移的问题,哪怕你用虚幻引擎渲染出再逼真的光线追踪反射,在观众眼里,那也只是一张在实拍人物背后拙劣移动的2D背景板。

Aximmetry对这个硬核痛点展现出了极度严谨的工业精神。它不依赖UE5内置那些为了游戏设计的妥协性组件,而是以一套独立的、军工级的摄像机标定系统与畸变合成管线,强行在物理镜头与虚拟视锥体之间,建立起了一座毫无偏差的数学桥梁。

正是因为Aximmetry在底层替我们挡住了那些混乱的非线性多项式和错综复杂的数据延迟,一线拍摄团队才能在片场自信地操作着大摇臂,肆意地转动着跟焦轮。而监视器里的虚拟世界,如同生根于物理大地一般,坚若磐石,无懈可击。